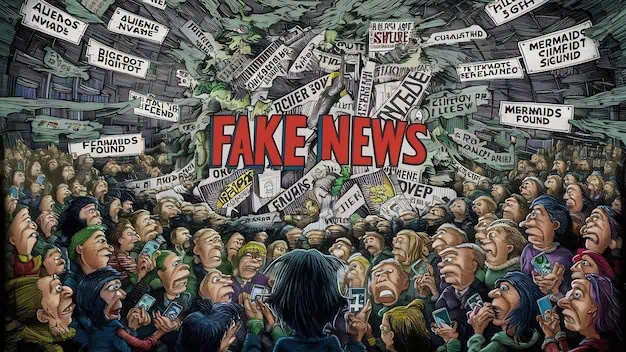

Negli ultimi anni, la proliferazione delle fake news sui social media ha rappresentato una seria minaccia per l’informazione e la percezione pubblica riguardo a eventi cruciali, come ad esempio, i conflitti armati. La piattaforma X, precedentemente nota come Twitter, ha recentemente annunciato una nuova policy mirata a contrastare la diffusione di contenuti fuorvianti generati dall’intelligenza artificiale (AI) legati a situazioni di guerra. Tuttavia, questa iniziativa solleva interrogativi sulla sua efficacia e sulle implicazioni più ampie per il panorama dei social media.

La nuova policy di X contro le fake news

Secondo quanto dichiarato da Nikita Bier, Head of Product di X, la piattaforma punterà a penalizzare i creator che pubblicano contenuti generati dall’AI riguardanti conflitti armati, a meno che non venga chiarita la loro origine fake. Coloro che non rispetteranno questa regola potrebbero affrontare una sospensione di 90 giorni dal programma di monetizzazione, con possibili ban permanenti in caso di recidive.

L’intento di questa policy è nobile e necessario, soprattutto in un contesto attuale caratterizzato da opinioni polarizzate e disinformazione. Tuttavia, il modo in cui viene attuata solleva dubbi: perché limitarsi a colpire solo i profili che generano profitto dalla piattaforma?

Le conseguenze della monetizzazione selettiva

Limitarne l’applicazione ai soli creator monetizzati può apparire come un approccio miope. In un’epoca in cui chiunque ha accesso a strumenti di creazione e diffusione di contenuti, è fondamentale estendere le misure di controllo a tutti gli utenti, indipendentemente dalla loro capacità di generare entrate. Le fake news non conoscono confini economici e possono diffondersi rapidamente anche da fonti non monetizzate.

Inoltre, gli algoritmi di rilevamento di contenuti manipolati o deepfake, già implementati da X, non sono sempre infallibili. La loro efficacia è stata messa alla prova in diverse occasioni, evidenziando la necessità di sviluppare soluzioni più robuste e inclusive per combattere la disinformazione.

Esempi recenti di disinformazione sui social media

Un caso emblematico che illustra la gravità del problema è rappresentato da un video virale che mostrava un presunto pilota di un caccia statunitense abbattuto. Nonostante l’immagine fosse stata certificata come generata da AI tramite la filigrana SynthID di Google, è stata condivisa milioni di volte come autentica. Situazioni simili possono avere ripercussioni devastanti, influenzando l’opinione pubblica e alimentando la propaganda.

Il ruolo dei social media nella disinformazione

Facebook, Instagram, LinkedIn, TikTok e Twitter (ora X) sono diventati strumenti fondamentali per la diffusione di notizie e informazioni, ma anche veicoli per la disinformazione. La capacità di queste piattaforme di influenzare l’opinione pubblica è straordinaria, rendendo cruciale il loro approccio nella gestione dei contenuti. Ogni decisione, come quella di X, ha il potenziale di influenzare non solo gli utenti ma anche l’intero ecosistema dell’informazione.

Le piattaforme social devono quindi affrontare la sfida di bilanciare la libertà di espressione con la necessità di proteggere gli utenti da contenuti fuorvianti. Le soluzioni devono essere integrate e non limitate a misure punitive, ma piuttosto orientate alla creazione di un ambiente informativo più sicuro e controllato.

In un contesto così complesso e in rapida evoluzione, la strategia di X rappresenta un passo significativo nella lotta contro la disinformazione, ma è chiaro che è solo l’inizio. La necessità di un approccio più inclusivo e rigoroso è evidente, e altre piattaforme social dovrebbero seguire l’esempio, affinché l’informazione online possa continuare a servire come un faro di verità e affidabilità.